L’écosystème du marketing digital traverse en 2026 une mutation structurelle d’une ampleur historique, redéfinissant de fond en comble les paradigmes de l’acquisition, de la mesure analytique et de l’engagement client. Pour les grands comptes, les entreprises de taille intermédiaire (ETI) et les multinationales opérant sur des marchés complexes et fragmentés, la convergence entre Google Analytics 4 (GA4), le Search Engine Advertising (SEA) et l’émergence fulgurante de l’Artificial Intelligence Optimization (AIO) constitue désormais le socle absolu et non négociable de toute stratégie de croissance pérenne.1 Le passage abrupt d’une observation réactive des données historiques à une modélisation prédictive et proactive propulsée par l’intelligence artificielle exige une refonte intégrale des architectures technologiques, des processus décisionnels et des méthodologies opérationnelles au sein des directions marketing.1

L’obsolescence programmée des modèles d’attribution traditionnels, couplée à une complexification des parcours d’achat et à un resserrement drastique des normes de confidentialité (approche privacy-first), impose aux annonceurs d’adopter des visions holistiques et synergiques.4 L’objectif des directions générales n’est plus la génération de simples indicateurs de volume, tels que les clics ou les impressions, mais le pilotage de stratégies d’acquisition orientées exclusivement vers le retour sur investissement (ROI) incrémental et la maximisation de la valeur vie client (Customer Lifetime Value, ou LTV).3 Parallèlement, ces mêmes organisations doivent apprendre à naviguer dans un environnement de recherche d’information qui échappe aux moteurs de recherche classiques pour être de plus en plus dominé par les moteurs génératifs assistés par l’intelligence artificielle et les agents conversationnels autonomes.7

Cette analyse de recherche exhaustive a pour vocation de décrypter les dynamiques sous-jacentes de ces évolutions technologiques et comportementales. Elle fournit un cadre stratégique détaillé, mathématiquement étayé et opérationnellement applicable pour l’optimisation des investissements digitaux des grands comptes, en déconstruisant les mécanismes de l’analytique moderne, de l’achat média automatisé et de la visibilité algorithmique de nouvelle génération.

La Métamorphose de l’Analytique : De l’Observation Descriptive à l’Intelligence Prédictive

L’année 2026 marque l’aboutissement fonctionnel de la transition conceptuelle initiée par le lancement de Google Analytics 4. Conçu initialement comme une réponse technique aux limitations inhérentes au suivi basé sur les sessions d’Universal Analytics, GA4 s’est métamorphosé en un véritable moteur d’intelligence artificielle sophistiqué.1 Sa finalité n’est plus de consigner le passé, mais de calculer et d’anticiper le comportement futur des utilisateurs avec une précision statistique rigoureuse, transformant des flux de données brutes en une cartographie prédictive de la croissance commerciale.1

L’Architecture Orientée Événements et la Résolution de l’Identité Omnicanale

La supériorité structurelle incontestable de GA4 réside dans son modèle de données event-based (orienté événements). Dans cette ontologie de la donnée, chaque interaction — qu’il s’agisse d’une vue de page, d’un défilement profond, d’un clic sur un élément d’interface, d’une lecture vidéo, d’un achat intégré à une application (in-app) ou d’un événement personnalisé métier — est traitée de manière totalement indépendante et autonome.9 Pour les grands comptes gérant des volumes de trafic massifs sur des architectures omnicanales intriquées (comprenant des sites web vitrines, des portails transactionnels B2B, et des applications mobiles iOS et Android), cette granularité offre une visibilité sans précédent sur la réalité des usages.9

Le système permet de cartographier des parcours utilisateurs complexes, itératifs et fragmentés à travers de multiples dispositifs matériels, résolvant ainsi le défi historique de la déduplication des utilisateurs qui faussait systématiquement les calculs de rentabilité.9 L’intégration de la fonctionnalité de suivi User-ID, largement consolidée et adoptée en 2026, permet d’associer un identifiant alphanumérique unique, généré par les bases de données de l’annonceur, à des utilisateurs individuels naviguant sur divers appareils au fil du temps.9 Cette fonctionnalité garantit une continuité analytique qui est absolument essentielle pour l’évaluation correcte des campagnes SEA dont les cycles de conversion sont longs, comme c’est fréquemment le cas dans les secteurs de l’industrie, du logiciel d’entreprise ou de l’immobilier.

De surcroît, l’activation par défaut de la technologie Google Signals enrichit massivement cette vue d’ensemble en exploitant de manière transparente les données agrégées et anonymisées des utilisateurs authentifiés au sein de l’écosystème Google (Gmail, YouTube, Chrome).9 Cette couche supplémentaire d’information fournit des signaux comportementaux et démographiques d’une richesse inégalée, permettant une segmentation d’audience d’une finesse qui était techniquement inaccessible dans les itérations précédentes des logiciels d’analyse web.9

Modélisation Algorithmique et Audiences Prédictives Avancées

L’innovation technologique la plus transformative pour l’ingénierie des stratégies d’acquisition réside dans le déploiement mature des audiences prédictives. GA4 ne se contente plus de comptabiliser passivement des visiteurs classés selon leurs actions passées ; il évalue mathématiquement les probabilités de conversion futures en s’appuyant sur des réseaux de neurones et des modèles de machine learning directement entraînés sur les signaux de première partie (first-party data) de l’annonceur.1

En 2026, ces métriques prédictives, intégrées dans ce que l’industrie nomme la version 2.0 des audiences de GA4, dépassent largement la simple probabilité binaire d’achat. Elles intègrent désormais des calculs probabilistes complexes concernant le risque de désabonnement (churn) et l’évaluation prédictive du potentiel de revenus générés à l’échelle de chaque utilisateur individuel.10 Ces modèles reposent sur des cadres statistiques avancés. Par exemple, l’estimation de la valeur vie client (LTV) utilise fréquemment des modèles probabilistes de type Pareto/NBD (Negative Binomial Distribution), où le taux de transaction d’un utilisateur est modélisé selon une distribution Gamma, permettant à l’algorithme d’inférer si un client inactif est en phase de latence naturelle ou s’il a définitivement quitté l’écosystème de la marque.

Trois segments prédictifs majeurs redéfinissent actuellement l’allocation des budgets publicitaires au sein des grandes structures commerciales :

Premièrement, le segment des acheteurs probables à court terme (Likely 7-Day Purchasers). Ce filtre algorithmique isole les utilisateurs ayant manifesté des séquences d’intention particulièrement fortes (telles que des ajouts au panier multiples combinés à un temps d’interaction prolongé sur des configurations de produits complexes ou des grilles tarifaires), mais n’ayant pas encore finalisé leur transaction.1 L’exportation automatisée et en temps réel de cette liste vers l’interface Google Ads permet de déployer des campagnes de remarketing hyper-ciblées dotées de stratégies d’enchères extrêmement agressives, maximisant ainsi la capture des conversions latentes à très court terme.1

Deuxièmement, la cohorte des meilleurs acheteurs prévus sur un cycle mensuel (Predicted 28-Day Top Spenders). Cette modélisation identifie les prospects dont l’empreinte comportementale indique qu’ils sont susceptibles de générer la valeur commerciale la plus élevée.1 Les directions marketing des grands comptes peuvent ainsi concentrer de manière asymétrique leurs investissements médias les plus coûteux et leurs offres promotionnelles les plus généreuses (services conciergerie, frais de port offerts sur de gros volumes) exclusivement sur ce segment spécifique, optimisant le retour sur les dépenses publicitaires (ROAS) de façon exponentielle.1

Troisièmement, le segment critique des utilisateurs à risque d’attrition (Likely Churning Users). Fondamental pour les modèles économiques basés sur la récurrence, tels que les éditeurs de logiciels en mode SaaS, les plateformes de streaming ou les programmes d’abonnements e-commerce, ce segment permet de déclencher des séquences de rétention proactives avant même que la résiliation ne se matérialise.1 En agissant sur ces signaux faibles, les entreprises réduisent drastiquement leurs taux de désabonnement, protégeant ainsi leur base de revenus récurrents et évitant les coûts astronomiques liés à l’acquisition de nouveaux clients de remplacement.1

La fluidité absolue de l’intégration entre GA4 et les plateformes d’activation média comme Google Ads ou Search Ads 360 permet une synchronisation bidirectionnelle continue de ces audiences. Cette architecture transforme fondamentalement l’outil analytique, qui passe du statut de simple tableau de bord récapitulatif à celui d’extension neurologique directe du moteur d’achat média.1

| Dimension Analytique | Logique Universal Analytics (Pré-2023) | Intelligence Google Analytics 4 (2026) | Impact Stratégique et Opérationnel pour l’Entreprise |

| Fondation des Données | Architecture rigide basée sur les sessions. | Modèle granulaire basé sur les événements. | Cartographie exhaustive et personnalisée des micro-conversions. |

| Résolution d’Identité | Dépendance critique aux cookies tiers. | Synthèse User-ID, Google Signals et IA. | Vision omnicanale fluide éliminant la duplication des coûts d’acquisition. |

| Logique de Segmentation | Rétrospective (analyse des actions révolues). | Prédictive (anticipation via Machine Learning). | Activation proactive des budgets sur les poches de rentabilité futures. |

| Mesure de la Rentabilité | Optimisation focalisée sur le CPA direct. | Modélisation probabiliste de la LTV et du Churn. | Pilotage financier aligné sur la valorisation à long terme de l’entreprise. |

Planification Financière Stratégique et Budgétisation Cross-Channel Intégrée

L’intégration de l’intelligence artificielle au sein des plateformes de Google ne se cantonne pas à la micro-optimisation tactique des audiences publicitaires ; elle s’étend désormais de manière spectaculaire à la macro-gestion financière des portefeuilles d’investissements. Les mises à jour structurelles majeures déployées au cours du premier trimestre 2026 positionnent définitivement GA4 comme un outil de planification financière, de budgétisation et de prévision budgétaire, rivalisant ouvertement avec des solutions tierces coûteuses de modélisation du mix marketing (Marketing Mix Modeling, ou MMM).5

Les Outils de Projection et la Simulation de Scénarios

La nouvelle fonctionnalité de budgétisation cross-channel introduit deux instruments d’aide à la décision mathématiques qui sont devenus critiques pour les directeurs marketing (CMO) et les gestionnaires de portefeuilles de grandes marques.5

Le premier instrument concerne les plans de projection (Projection Plans). Ceux-ci sont spécifiquement conçus pour répondre aux problématiques de rythme de dépense, connues sous le terme de pacing.5 Ces plans évaluent dynamiquement si les investissements actuels sont mathématiquement alignés avec les trajectoires de performance prévues par les comités de direction. En ingérant en continu les données de coûts importées depuis une multitude de plateformes publicitaires concurrentes (Google Ads, Meta Ads, LinkedIn Ads, TikTok Ads, réseaux programmatiques), le système algorithmique extrapole les volumes de conversions et les revenus futurs probables. Cette visibilité algorithmique permet aux équipes opérationnelles d’identifier instantanément les anomalies de performance, les rendements décroissants ou, à l’inverse, les sous-consommations budgétaires sur des canaux rentables, permettant de réagir par des décisions d’optimisation rapides sans dépendre de l’agrégation manuelle de feuilles de calcul disparates.5

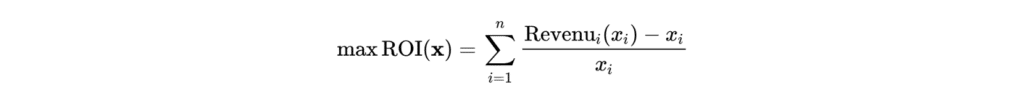

Le second instrument, tout aussi déterminant, concerne les plans de scénarios (Scenario Plans). Cette fonctionnalité relève de la stratégie d’allocation pure.5 Elle offre aux analystes la capacité de simuler virtuellement différentes distributions budgétaires à travers de multiples canaux pour déterminer avec précision le point d’inflexion optimal du retour sur investissement. Le fonctionnement repose sur des régressions statistiques évaluant l’élasticité de chaque canal. Formellement, le système tente de maximiser la fonction de ROI globale :

où représente le budget alloué au canal

. Pour les entreprises de grande envergure soumises à de fortes variations saisonnières de la demande, à l’instar des secteurs du tourisme, du commerce de détail ou des services industriels, ces modélisations permettent d’anticiper mathématiquement les conséquences financières d’une augmentation brutale ou d’une contraction des investissements, et ce, avant même d’engager la moindre dépense réelle.5

L’efficacité pratique de ces fonctionnalités prédictives reste cependant strictement conditionnée par une hygiène des données irréprochable au sein de l’organisation. Sans l’importation systématique, standardisée et automatisée des données de coûts issues de l’ensemble de la pile technologique marketing, et sans une définition rigoureuse et validée des événements de conversion clés (Key Events), ces modélisations algorithmiques produiront inévitablement des résultats erronés, illustrant le célèbre adage informatique « garbage in, garbage out ».5 L’architecture de GA4 récompense donc de manière disproportionnée les organisations qui démontrent la maturité technologique nécessaire pour consolider leurs flux de données fragmentés au sein d’un écosystème d’analyse centralisé unique.5

La Révolution de l’Attribution Indépendante des Conversions

L’un des défis les plus chroniques et générateurs de frictions dans la gestion historique des campagnes SEA pour les grands comptes a toujours été la divergence structurelle des données de conversion entre les interfaces de gestion publicitaire (comme Google Ads ou SA360) et les systèmes de web analytique. En 2026, GA4 résout cette dissonance cognitive et opérationnelle grâce à une mise à jour fondamentale de l’architecture de gestion des conversions web.5

Il est désormais techniquement possible d’ajuster les paramètres de modélisation d’attribution de manière totalement indépendante pour chaque événement de conversion spécifique configuré dans la propriété.5 Auparavant, les annonceurs étaient soumis à une contrainte structurelle forte : ils devaient appliquer un modèle d’attribution global et indifférencié (par exemple, le modèle d’attribution basé sur les données, ou data-driven attribution) à l’échelle de l’ensemble de la propriété analytique. Aujourd’hui, un grand compte B2B peut configurer le système pour qu’un appel téléphonique provenant d’une campagne SEA obéisse à une fenêtre d’attribution courte axée sur le dernier clic, tout en stipulant qu’une transaction e-commerce complexe impliquant de multiples visites de recherche organique et payante étalées sur une période de 90 jours bénéficie d’une modélisation basée sur la dégradation temporelle ou l’intelligence algorithmique.

Cette finesse granulaire permet d’affiner considérablement les performances des stratégies d’enchères intelligentes (Smart Bidding) déployées dans Google Ads. En isolant techniquement les signaux commerciaux forts (ventes finalisées, contrats B2B signés, ouvertures de comptes vérifiées) des signaux comportementaux faibles (téléchargements de brochures informatives, temps de session prolongé sur une page de blog, visionnages de vidéos), le moteur algorithmique d’enchères de Google Ads n’est plus artificiellement pollué par des objectifs secondaires de vanité.5 Il peut ainsi concentrer l’intégralité de sa puissance de calcul et de son budget sur la génération de résultats commerciaux tangibles et directement corrélés au compte de résultat de l’entreprise.5 De surcroît, cette évolution élimine la principale cause de suspicion des comités de direction à l’égard des reportings digitaux en réconciliant enfin les visions d’attribution des différentes plateformes.5

Le Paradigme Privacy-First et la Suprématie Incontestée de la First-Party Data

Le resserrement continu de l’étau réglementaire mondial autour de la protection des données personnelles, couplé aux initiatives unilatérales des constructeurs de navigateurs et de systèmes d’exploitation (telles que l’App Tracking Transparency d’Apple), a définitivement sonné le glas de l’ère du suivi publicitaire permissif basé sur les cookies tiers. En 2026, la conformité aux législations exigeantes — qu’il s’agisse des évolutions du RGPD en Europe, des réglementations strictes en Australie ou des mosaïques législatives des États américains — a propulsé les stratégies de confidentialité (privacy-first) du rang de simple préoccupation juridique à celui d’impératif absolu de survie commerciale et d’avantage concurrentiel.2

Le Consentement Utilisateur comme Levier Technologique de Contrôle

L’industrie du marketing digital s’est massivement réorientée vers un modèle opérationnel où le consentement explicite de l’utilisateur n’est plus perçu comme un obstacle frictionnel ou une simple case à cocher juridique, mais bien comme le fondement originel de toute relation client et l’unique autorisation légitime pour l’activation des données à des fins de ciblage.13 Les études menées par des entités telles que la Digital Advertising Alliance démontrent que la gestion éthique des pratiques de traitement des données est devenue un critère de choix pour les utilisateurs.13

Les consommateurs de 2026, confrontés à une incertitude macroéconomique globale et souffrant d’une fatigue émotionnelle et numérique intense, exigent une transparence sans faille quant à l’utilisation commerciale de leurs informations personnelles.14 Les recherches sociologiques indiquent qu’ils valorisent les marques qui respectent leur bien-être digital présent et qui utilisent l’intelligence des données de manière responsable, non pas pour les traquer, mais pour fluidifier et améliorer leur expérience immédiate.14

Dans ce contexte restrictif, les données de première partie (les first-party data, mais également les zero-party data déclaratives) — c’est-à-dire les données collectées directement par l’entreprise via ses propres canaux numériques et physiques, avec l’accord transparent de l’utilisateur — se sont imposées comme l’actif immatériel le plus précieux des bilans des grands comptes.2 La compétitivité structurelle d’une organisation repose désormais sur sa capacité d’ingénierie à orchestrer la collecte, la sécurisation, la normalisation et l’activation de ces données au travers de systèmes de gestion unifiés, tels que les CRM (Customer Relationship Management) ou les CDP (Customer Data Platforms), et de les interconnecter de manière transparente avec les moteurs d’achat média.4

Cependant, un gouffre d’exécution subsiste au sein de l’industrie. Bien que près de 15 millions de sites web exploitent GA4 comme infrastructure analytique principale, des rapports du secteur révèlent qu’en 2026, à peine 38 % des responsables marketing ont réussi l’exploit technique et organisationnel de connecter de manière bidirectionnelle leur propriété GA4 à leur système CRM ou à un entrepôt de données structuré.15 Ce chiffre alarmant indique que la majorité des entreprises, paralysées par les silos internes, la dette technologique ou les craintes de non-conformité, sous-exploitent massivement le logiciel, le reléguant au rang de simple outil de comptage de visites, alors qu’il a été architecturé pour fonctionner comme un centre de commande intégré de l’ensemble de la pile marketing.15 Les 62 % restants naviguent à l’aveugle, incapables de réconcilier les coûts d’acquisition initiaux avec la valeur à long terme générée hors ligne ou dans des cycles de vente différés.

Mathématiques de la Confidentialité Différentielle et Modélisation Comportementale

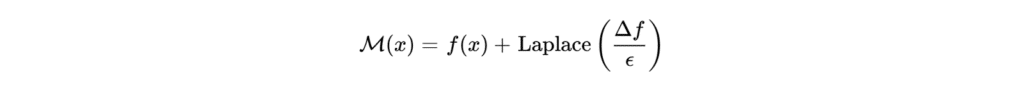

Pour pallier la perte inévitable et massive de signaux de conversion causée par l’utilisation croissante de la navigation privée, le déploiement généralisé des bloqueurs de publicités algorithmiques et les refus explicites de consentement via les bannières de gestion des cookies, les outils d’analyse d’entreprise ont dû opérer une mue scientifique radicale.10 La réponse technologique apportée par Google Analytics 4 repose sur l’intégration native de concepts statistiques avancés, principalement la confidentialité différentielle (differential privacy) et l’amélioration continue du Behavioral Modeling (modélisation comportementale).10

La confidentialité différentielle est un cadre mathématique rigoureux qui permet d’extraire des modèles comportementaux pertinents et des tendances macroscopiques à partir de vastes ensembles de données, tout en garantissant qu’il soit mathématiquement et cryptographiquement impossible d’isoler, de rétro-ingénier ou d’identifier les actions d’un individu spécifique au sein de l’échantillon analysé.10 Ce tour de force est accompli par l’injection délibérée d’un « bruit » statistique soigneusement calibré dans les données agrégées. Si l’on considère une fonction de requête de données

, tel que :

En ajustant ce bruit probabiliste, Google assure aux annonceurs une conformité totale et inattaquable face aux législations les plus restrictives, tout en préservant l’intégrité et la validité des analyses de tendances globales nécessaires au pilotage financier.

Dans la pratique opérationnelle, lorsqu’une proportion significative d’utilisateurs refuse le dépôt de traceurs (refus des cookies), les réseaux d’apprentissage automatique de GA4 analysent finement les schémas de navigation des utilisateurs consentants, qui agissent alors comme un groupe de contrôle représentatif. Le système extrapole ensuite ces données validées pour modéliser le comportement de la cohorte non consentante, reconstituant ainsi une vision complète et fiable du tunnel de conversion.10 Cette ingénierie de modélisation avancée est devenue la condition sine qua non pour évaluer correctement la contribution réelle des investissements SEA, particulièrement sur les requêtes génériques situées très en amont dans le parcours de recherche, requêtes qui subissent de plein fouet l’attrition des signaux déterministes.10

Performance Max et l’Automatisation SEA : De l’Achat de Mots-clés à l’Optimisation par le « Data Fuel »

L’intégration native, fluide et sans latence entre les propriétés GA4 et les écosystèmes d’activation publicitaire exclusifs à Google, notamment Google Ads et Search Ads 360 (SA360 pour les acheteurs en agences médias), représente le cœur névralgique de l’optimisation des performances pour les campagnes de très grande envergure.16 Le paradigme séculaire de la gestion des campagnes SEA consistant à ajuster manuellement et quotidiennement des enchères sur des grappes de mots-clés spécifiques est définitivement révolu. La compétence stratégique consiste désormais à ingérer, formater et transmettre les signaux de données les plus denses et les plus qualifiés possibles pour guider et borner les intelligences artificielles décisionnelles de Google.12

L’Intégration Bidirectionnelle et la Suprématie de Performance Max

Les campagnes automatisées Performance Max (communément appelées PMax) incarnent l’aboutissement de cette évolution vers une omnicanalité publicitaire pilotée par la machine. PMax consolide l’ensemble des inventaires publicitaires disparates de Google (le réseau de Recherche classique, le réseau Display, YouTube, Discover, Gmail et Maps) au sein d’une enveloppe de campagne unique, pilotée par un algorithme d’optimisation central. Le succès critique d’une structure PMax pour un grand compte ne repose plus sur la créativité du ciblage manuel, mais repose presque exclusivement sur la qualité, la fraîcheur et la pertinence des « signaux d’audience » (audience signals) qui lui sont fournis par l’annonceur en guise de points de repère.10

L’innovation structurelle majeure confirmée en 2026 réside dans l’établissement d’un flux de données véritablement continu et bidirectionnel entre l’entrepôt analytique de GA4 et le moteur d’exécution de Performance Max.10 En ingérant de manière ininterrompue les audiences prédictives calculées par GA4 (les acheteurs probables à haute vélocité, les profils à LTV exceptionnelle étudiés précédemment), PMax calibre son système de Smart Bidding en temps réel. L’algorithme évalue simultanément des millions de combinaisons de signaux contextuels invisibles pour l’analyste humain — incluant l’heure exacte de la journée, le type de connexion réseau, l’OS de l’appareil mobile, la vélocité de géolocalisation, et l’historique sémantique de navigation de l’utilisateur sur les 30 derniers jours — pour diffuser le message textuel ou visuel le plus percutant à la milliseconde précise où l’intention probabiliste de conversion atteint son apogée statistique.10 L’objectif assigné à la machine n’est plus la minimisation indifférenciée d’un coût par acquisition (CPA) moyen, mais la maximisation agressive d’un ROAS cible, fluctuant dynamiquement en fonction de la valeur de rentabilité prédictive calculée pour chaque impression publicitaire individuelle.17

Du Spécialiste Opérationnel au Stratège Architecte de la Donnée

Ce niveau d’automatisation cognitive déplace radicalement le centre de gravité de la valeur ajoutée et des compétences requises au sein des agences partenaires et des départements marketing internes. Les tâches opérationnelles purement exécutives et chronophages, telles que l’ajustement micrométrique des CPC, la négativation fastidieuse de termes de recherche non pertinents ou la rotation manuelle des bannières, sont définitivement reléguées aux routines algorithmiques.12 L’avantage concurrentiel d’un grand compte sur son marché de référence repose désormais sur le volume et la pureté du « carburant de données » (data fuel) qu’il est capable d’injecter dans la matrice décisionnelle algorithmique.12

Les entreprises qui dominent leurs secteurs économiques en 2026 ne sont plus nécessairement celles qui déploient les budgets d’achat d’espace les plus massifs de manière extensive, mais bien celles qui démontrent une rigueur implacable dans la structuration technique de leurs événements de conversion en aval, qui naviguent avec habileté dans les contraintes des normes de confidentialité, et qui orchestrent une synergie opérationnelle totale entre les départements en charge de l’acquisition organique, du référencement payant et de l’ingénierie de la donnée.3 L’approche adoptée par des agences d’excellence, à l’instar des méthodologies de Performance Marketing portées par Million Marketing et son expertise senior, démontre que le rôle du spécialiste SEA s’est mué en celui d’un véritable architecte de flux de données. Sa mission fondamentale est de garantir que les boîtes noires algorithmiques orientent leurs puissances de calcul vers la réalisation de véritables objectifs d’affaires (croissance du chiffre d’affaires net, acquisition de parts de marché) plutôt que de s’épuiser dans l’optimisation de mesures de vanité superficielles (taux de clics, impressions visibles).3

L’Avertissement Stratégique : L’Émergence de l’AIO (Artificial Intelligence Optimization)

Si la convergence technologique entre GA4, les first-party data et les automatisations du SEA permet de sécuriser et de rentabiliser le trafic issu des intentions directes, l’écosystème de la visibilité organique subit un bouleversement d’une magnitude qualifiée de sismique par les analystes de l’industrie. L’intégration rapide et généralisée de l’intelligence artificielle générative au cœur même des moteurs de recherche dominants consacre en 2026 l’avènement de l’Artificial Intelligence Optimization (AIO) — discipline également désignée par les acronymes GEO (Generative Engine Optimization) ou AEO (Answer Engine Optimization) — comme une pratique stratégique distincte, complexe, et absolument indispensable pour la survie numérique des grandes marques, évoluant en parallèle, et parfois en opposition, avec le SEO traditionnel.8

L’Effondrement du Modèle des Liens Bleus et la Synthèse Générative

Historiquement, la pratique de l’optimisation pour les moteurs de recherche (SEO) obéissait à un paradigme d’indexation linéaire : il s’agissait d’optimiser l’architecture et le contenu de pages web pour qu’elles correspondent à la taxonomie de mots-clés spécifiques saisis par les internautes, dans le but ultime d’obtenir une position élevée dans la liste des résultats et de déclencher un clic redirigeant le trafic vers le site propriétaire de l’annonceur. Le paradigme imposé par l’AIO est d’une nature cognitive radicalement différente.19 Les systèmes conversationnels de nouvelle génération, qu’il s’agisse de ChatGPT d’OpenAI, de Perplexity, de l’écosystème Gemini de Google ou des interfaces intégrées comme les AI Overviews (AIOs) au sein des pages de résultats de Google, ne se contentent plus de lister passivement des hyperliens bleus de redirection ; ils lisent, ingèrent, synthétisent et génèrent de manière autonome des réponses textuelles directes, fluides et exhaustives aux requêtes complexes des utilisateurs.8

Les données d’études sectorielles illustrent l’ampleur de ce basculement. Dès août 2025, de vastes enquêtes (notamment celles de cabinets comme McKinsey, portant sur près de 2000 décideurs et consommateurs) indiquaient de manière irréfutable que 50 % des consommateurs avaient basculé vers une utilisation régulière de la recherche propulsée par l’intelligence artificielle. Les modèles macroéconomiques projettent que les décisions d’achat dictées ou lourdement influencées par les recommandations des IA génératives impacteront directement la somme vertigineuse de 750 milliards de dollars de revenus commerciaux annuels sur le seul marché nord-américain d’ici 2028.8 Concomitamment, les rapports d’analyse spécialisés basés sur des échantillons de propriétés GA4 ont mesuré une croissance astronomique du trafic web qualifié de « référence IA », avec des sauts quantitatifs dépassant les 527 % de croissance d’une année sur l’autre.8

Par voie de conséquence, l’enjeu existentiel pour une marque B2B ou B2C ne se limite plus à figurer organiquement dans les premières pages de résultats traditionnels (les SERPs). L’objectif suprême de la visibilité numérique consiste désormais à être formellement citée et référencée comme la source factuelle d’autorité par le grand modèle de langage (LLM) au moment exact où ce dernier génère sa réponse synthétique à l’utilisateur.19 Comme le résument les experts de l’ingénierie des moteurs de réponses : si le contenu numérique d’une marque n’est pas structurellement formaté pour être ingéré et validé par ces intelligences artificielles, cette marque cesse littéralement d’exister dans les réalités de recherche générées par l’IA, s’exposant à une mort commerciale silencieuse et invisible.20

Les Mécanismes Techniques Profonds de l’AIO : Vecteurs, Chunks et Citations Sémantiques

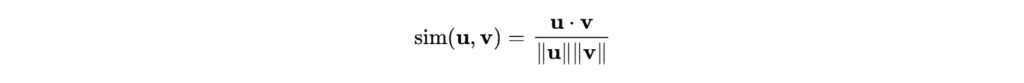

Les grands modèles de langage et les architectures de type RAG (Retrieval-Augmented Generation) utilisés pour les réponses en temps réel fonctionnent selon des principes mathématiques et d’ingénierie de l’information profondément distincts de ceux des robots d’exploration (crawlers) classiques du début des années 2010. Ces modèles fragmentent le corpus textuel mondial en petits segments d’information sémantiquement cohérents, désignés sous le terme de chunks, et transforment la signification sémantique de ces segments en représentations mathématiques sous forme de vecteurs multidimensionnels.22 Lorsqu’un utilisateur soumet une requête (un prompt), le système convertit cette question en vecteur, et recherche dans son immense base de données les vecteurs de chunks documentaires qui sont les plus proches mathématiquement en mesurant la similarité cosinus. Soit le vecteur de la requête utilisateur et

le vecteur d’un segment de texte, la pertinence est évaluée par l’équation :

Le LLM assemble ensuite ces chunks hautement pertinents pour formuler une réponse articulée en langage naturel.22

Cette architecture technologique bouleverse les règles de la création de contenu :

- Densité de l’Information et Formatage Structurel : Là où le SEO traditionnel récompensait et encourageait la production de très longs textes dilués, répétant ad nauseam des mots-clés pour accroître la densité lexicale, l’AIO privilégie de manière drastique les contenus extrêmement denses, richement structurés et facilement extractibles par les systèmes de traitement du langage naturel (NLP).22 Un contenu éditorial perçu comme superficiel, creux ou verbeux (qualifié de « thin chunk » par les ingénieurs) a des probabilités quasi nulles d’être récupéré et synthétisé par le modèle linguistique, et ce, même si la page hébergeant ce contenu bénéficie par ailleurs d’un excellent classement dans l’index SEO classique grâce à l’ancienneté de son domaine.22 L’adoption par les agences des immenses bases de données comprenant plus de 213 millions de requêtes (prompts) structurées permet d’auditer et d’aligner le contenu des marques sur la manière exacte dont les IA interrogent le monde.23

- Les Signaux d’Autorité (Framework E-E-A-T) et la Fin de l’Hégémonie des Backlinks : L’évaluation par Google de l’Expérience, de l’Expertise, de l’Autorité et de la Fiabilité (Trustworthiness) — le fameux triptyque E-E-A-T — demeure le fondement de la réputation, mais les mécanismes de sa validation algorithmique ont évolué.18 La monnaie d’échange historique de la crédibilité du web, à savoir les liens entrants (backlinks), perd de son pouvoir prédictif absolu. Dans les modèles AIO, ce sont les citations directes, les mentions explicites de la marque (brand mentions) dans des contextes hautement qualitatifs, et la reconnaissance par d’autres entités sémantiques fortes qui constituent la nouvelle devise de la réputation algorithmique.20 Les LLM accordent une confiance démesurée aux entités qui sont fréquemment associées à une expertise sectorielle dans la littérature numérique, indépendamment du nombre brut de liens pointant vers leur serveur.20

- L’Ingénierie de la Réponse pour les Answer Engines : Pour forcer le système à citer une entreprise, les développeurs web doivent intégrer des balises sémantiques spécifiques. L’utilisation massive et sans erreur des schémas de données structurées (notamment les types FAQPage, QAPage, ou HowTo standardisés via schema.org), la formulation de titres directement sous forme de questions explicites (ex: <h2>Qu’est-ce que l’Optimisation par IA?</h2>) immédiatement suivies de définitions directes, concises et factuelles en une seule phrase, et l’intégration de tableaux de données clairs et formatés en Markdown ou HTML strict sont devenus des prérequis d’ingénierie non négociables.20 Ce formatage chirurgical fournit des « crochets de citation » (citation hooks) pré-mâchés qui soulagent la charge de calcul des LLM, les incitant mathématiquement à intégrer ces données prêtes à l’emploi dans leurs réponses.20

L’Agentic Shopping : L’Avenir du Commerce Autonome

L’évolution la plus radicale et la plus disruptive induite par l’intelligence artificielle en 2026 est la transition des interfaces de simple recommandation vers des systèmes d’action directe et autonome. L’avènement commercial des agents intelligents d’achat (AI Shopping Agents) modifie structurellement la topologie même du parcours d’acquisition consommateur.7 Des initiatives colossales, telles que les partenariats stratégiques noués entre de géants du commerce mondial (Shopify, Walmart, Target) et les leaders technologiques de l’IA (OpenAI, Google via ses modèles Gemini), ou les déploiements open-source de plateformes de type NemoClaw par NVIDIA, démontrent que l’agentic commerce est passé de la théorie de laboratoire à la réalité économique mesurable.7

L’architecture comportementale est inédite : il est désormais de plus en plus courant qu’un consommateur délègue entièrement la charge cognitive d’une intention d’achat à un agent virtuel intégré dans des applications de messagerie cryptées (telles que Telegram ou WhatsApp) ou des assistants d’entreprise (Slack).7 Sur simple requête en langage naturel textuel ou vocal (« Trouve-moi la meilleure station d’accueil pour ordinateur portable compatible avec mes écrans actuels, disponible à moins de 5 kilomètres et en promotion »), l’agent autonome scrute les inventaires géolocalisés, compulse et résume les avis clients, identifie l’allée exacte dans le magasin physique et exécute la transaction de manière sécurisée.7 Ce processus se déroule dans un circuit totalement fermé, sans que l’utilisateur n’ait jamais navigué sur le site web transactionnel du commerçant, ni téléchargé son application mobile, et, plus inquiétant pour les modèles publicitaires classiques, sans qu’il n’ait été exposé à la moindre bannière ou annonce sponsorisée.7 Pour capter cette nouvelle manne de demande qui transite exclusivement de machine à machine via des protocoles d’agents, les architectures de données des grands comptes (catalogues de produits, flux Google Merchant Center alimentant les campagnes PMax, données d’inventaires locaux) doivent impérativement être structurées, validées et optimisées pour être lisibles sans friction par ces intelligences artificielles non humaines.7

La Coexistence Stratégique Indispensable entre SEO et AIO

Toutefois, malgré cet essor technologique foudroyant de l’AIO, les consultants stratégiques s’accordent à affirmer que décréter la mort programmée du SEO traditionnel constituerait une erreur analytique et commerciale tragique.21 Les données de trafic empiriques de l’année 2026 prouvent que les interfaces classiques des moteurs de recherche génèrent encore la vaste majorité du trafic numérique de découverte et d’exploration.22 L’intelligence artificielle n’a pas purement et simplement supplanté le SEO ; elle l’a complété, fragmenté et spécialisé dans le traitement des requêtes informationnelles complexes.22

Néanmoins, la rentabilité de l’AIO est disproportionnée : les analyses démontrent systématiquement que les cohortes de trafic provenant de plateformes conversationnelles optimisées par l’IA convertissent à des taux faramineux, significativement supérieurs (pouvant aller jusqu’à 4,4 fois plus de conversions) au trafic naturel classique. Cette performance s’explique par le fait que l’utilisateur reçoit une réponse hautement contextualisée, exempte de distractions, et directement alignée sur son intention de recherche la plus spécifique.22

La doctrine stratégique optimale pour les gestionnaires de grands comptes exige par conséquent de financer, d’équiper et de piloter ces deux approches technologiques de front, sans cannibalisation budgétaire. Les cabinets de conseil et les experts sectoriels convergent vers une recommandation d’allocation des ressources macroéconomiques pragmatique : investir environ 70 à 80 % des ressources humaines et budgétaires dédiées à l’organique pour entretenir, sécuriser et consolider les fondations SEO classiques (garantissant la rentabilité des acquis de trafic volumique sur les requêtes commerciales de courte traîne), et sanctuariser les 20 à 30 % restants pour l’ingénierie pure, l’expérimentation agressive et le déploiement des méthodologies AIO (afin de préempter les positions de leadership sur les recherches longues de haute valeur ajoutée et d’ancrer la marque dans la mémoire synthétique des futurs modèles d’IA).22

| Vecteur d’Optimisation | SEO Traditionnel (Heuristique classique) | AIO / GEO (Generative Engine Optimization) |

| Finalité Commerciale | Générer du trafic volumique (clics) vers un nom de domaine contrôlé. | Être la source incontestée d’une réponse générée in-situ par un LLM. |

| Architecture Technologique | Crawling séquentiel, indexation inversée par mots-clés, maillage de liens. | Transformation vectorielle, RAG (Retrieval-Augmented Generation), similarité cosinus. |

| Indicateurs de Performance (KPI) | Positionnement (Rank) dans les SERPs, CTR, Sessions organiques. | Fréquence de citation par les bots, visibilité dans les AI Overviews, Mentions de marque. |

| Topologie du Contenu | Textes longs et dilués, hiérarchie sémantique H1/H2, répétition lexicale. | Chunks d’information denses, paragraphes factuels courts, données structurées intensives (JSON-LD). |

| Validation de l’Autorité | Le graphe de liens entrants (Backlinks) quantitatifs et qualitatifs. | L’omniprésence sémantique, les citations de marque, la validation E-E-A-T par les entités paires. |

La Fin des Entonnoirs Conventionnels : Le Déploiement du Concept de « Marketing Playground »

Les mutations technologiques profondes induites par l’application conjointe de GA4, des enchères PMax et des moteurs AIO ne se limitent pas à une révolution technique ; elles s’accompagnent d’un changement psychologique structurel dans le comportement du consommateur digital et de l’acheteur B2B. Les métaphores conceptuelles dominantes du marketing du 20e siècle, et particulièrement celle de l’entonnoir de conversion traditionnel (marketing funnel, découpé rigidement en phases de sensibilisation, considération et décision), s’avèrent de plus en plus dysfonctionnelles et inefficaces face à des acheteurs sophistiqués. Ces derniers rejettent massivement les pressions commerciales directes, les relances intrusives non désirées et les parcours de navigation perçus comme coercitifs.24

Les recherches quantitatives les plus exhaustives menées sur les cycles d’achat en 2026, corroborées par des entités analytiques de premier plan, révèlent une inflation de la complexité : un acheteur, qu’il opère dans un contexte B2B pour la signature d’un contrat de prestation logicielle ou dans un contexte B2C pour un achat à forte implication financière, nécessite désormais de croiser entre 8 et 12 points de contact (touchpoints) distincts, disséminés sur une multitude de plateformes, avant de franchir le seuil psychologique de la confiance et de finaliser une transaction économique.24 Cette métrique représente un saut quantitatif massif par rapport aux 2 à 4 points de contact qui constituaient la norme au début de la décennie. La fragmentation vertigineuse de l’attention quotidienne — écartelée entre le streaming continu de vidéos, le scrolling algorithmique sur les réseaux sociaux, le searching informatif sur les moteurs, et le shopping instantané — impose impérativement une redéfinition radicale des théories de l’engagement.14

L’approche conceptuelle émergente, adoptée et modélisée par les agences d’excellence en stratégie de performance digitale (et formalisée dans des méthodologies de croissance avancées), abandonne l’idée d’entonnoir coercitif au profit du concept de Marketing Playground (que l’on pourrait traduire par espace d’interaction libre et constructif).24 Plutôt que de forcer la progression d’un utilisateur à travers une séquence rigide et prédéterminée de formulaires de capture d’e-mails et de relances automatisées, la stratégie contemporaine consiste à concevoir, bâtir et offrir un écosystème numérique riche, ouvert et intrinsèquement utile à la cible.24 Cet espace intègre des contenus interactifs, des outils d’auto-diagnostic, des calculateurs de ROI, des micro-évaluations ludiques ou des ateliers virtuels gratuits, qui répondent directement aux problématiques brûlantes (problem-aware) de l’utilisateur.24

Cette méthodologie s’inscrit dans un paradigme d’empathie psychologique. Elle repose sur le constat, issu des neurosciences de la décision commerciale, qu’avant d’accepter une prescription (le produit de l’annonceur), le prospect doit ressentir que son besoin a été intimement compris, validé et diagnostiqué.24 En déployant une « empathie radicale » à travers ces expériences numériques interactives, la marque ne force pas la vente ; elle démontre une supériorité d’expertise qui rassure émotionnellement le client fatigué.24

Du point de vue de l’ingénierie des données, cette approche du Playground s’emboîte de manière chirurgicale avec les capacités de traçage orientées événements de Google Analytics 4.9 Chaque interaction subtile de l’utilisateur avec un calculateur ou un simulateur au sein de cet espace libre génère un événement paramétré spécifique.9 Ces données comportementales de première partie, récoltées avec un consentement enthousiaste puisque liées à une réelle utilité, constituent de véritables micro-conversions qui viennent abreuver massivement les modèles prédictifs de GA4 et de PMax détaillés précédemment.24 Au fil du temps, l’algorithme cartographie la maturité du prospect. Lorsqu’il détecte, via la croisée de milliers de signaux statistiques, que l’utilisateur atteint la maturité psychologique optimale pour l’acte d’achat, les systèmes de ciblage IA déclenchent l’affichage de l’offre commerciale finale (via le SEA ou le retargeting social) au moment exact où la probabilité de transaction est maximale et où la résistance cognitive est à son seuil le plus bas.10

L’IA Générative et la Création à l’Échelle : Résoudre l’Équation de la Fatigue Créative

Cependant, l’hyper-personnalisation chirurgicale permise par les audiences prédictives de GA4, couplée à la vélocité fulgurante de la diffusion algorithmique automatisée via les campagnes Performance Max ou Social Ads, se heurte inévitablement à un écueil logistique industriel critique : la « fatigue créative » des audiences publicitaires.3 En effet, si un moteur de Machine Learning est parfaitement capable d’identifier 50 sous-segments d’audience distincts en temps réel et de modifier les enchères programmatiques de plusieurs milliers de requêtes en une fraction de seconde, l’impact de l’investissement média restera structurellement nul si le message servi à l’utilisateur est une déclinaison statique, générique ou répétitive de la même image conceptuelle. Les consommateurs, saturés d’informations, développent une cécité algorithmique aux formats répétitifs.

La production massive, rapide, itérative et qualitative d’assets créatifs visuels, textuels et vidéo est ainsi devenue, en 2026, le principal goulot d’étranglement limitant la rentabilité des stratégies de croissance basées sur le SEA et le Paid Social à très grande échelle.3 Pour faire voler en éclats ce plafond de verre de la production, l’adoption systématique et industrialisée de l’intelligence artificielle générative (multimodale) au cœur même des processus d’idéation et de création est passée en quelques mois du stade de l’expérimentation audacieuse à celui de norme opérationnelle incontournable pour les annonceurs matures.

Les données macroéconomiques du secteur valident cette intégration massive : en 2026, près de la moitié (46 %) des directeurs marketing de dimension mondiale utilisent nativement l’intelligence artificielle pour mettre à l’échelle leur volume de production de contenus créatifs sans exploser leurs budgets d’agence traditionnelle, tandis que 33 % des organisations les plus avant-gardistes déclarent faire fonctionner l’intelligence artificielle de manière totalement transversale, connectant harmonieusement la création artistique, le déploiement de l’achat média, et la mesure de l’attribution analytique.25

Pour répondre à cette pression opérationnelle insoutenable pour les équipes graphiques classiques, les agences d’excellence digitale ont développé des infrastructures hybrides sophistiquées. L’approche incarnée par le concept de Million IA Studio, par exemple, illustre la mise en place de structures internes qui exploitent la puissance brute de calcul des IA génératives (pour la manipulation d’images vectorielles complexes, l’animation 3D, et le montage vidéo) afin de produire et de décliner des assets visuels et audiovisuels à très haute performance, le tout à une échelle industrielle inédite.3 Ces studios créatifs augmentés sont technologiquement équipés pour générer dynamiquement des dizaines de milliers de variations subtiles de vidéos verticales ultra-courtes (short-form content), de bannières animées, et de copies d’annonces (copywriting), garantissant une stricte adéquation avec les codes de communication, la grammaire technique et les contraintes de formatage propres à chaque canal d’acquisition spécifique (de l’esthétique organique exigée par TikTok aux standards institutionnels de LinkedIn, en passant par les contraintes visuelles de Meta et l’espace condensé de Google Discover).2

L’avantage concurrentiel asymétrique procuré par l’IA créative intégrée pour la gestion d’un grand compte mondialisé réside dans son aptitude à assurer une stricte conformité aux charte graphiques et aux directives de l’identité de marque globale (brand guidelines), tout en injectant une diversité visuelle algorithmique capable de tromper la fatigue publicitaire neurologique du consommateur final.

Par ailleurs, l’un des phénomènes statistiques les plus révélateurs de l’année met en lumière le désir profond des annonceurs de sécuriser leurs investissements avant tout décaissement réel. Plus d’un tiers (31 %) des leaders du marketing expriment la volonté d’utiliser des modèles prédictifs d’IA pour valider les performances théoriques de leurs visuels avant même le lancement des enchères, tandis qu’une proportion spectaculaire de 40 % exprime l’exigence de pouvoir pré-tester la résonance émotionnelle de leurs créations publicitaires sur des « audiences synthétiques » — des groupes virtuels générés par des algorithmes d’IA qui simulent les comportements et les biais cognitifs d’une cible démographique réelle.25 L’implémentation de tels processus de contrôle qualité pré-lancement permet aux entreprises de minimiser massivement le gaspillage financier colossal inhérent aux phases traditionnelles d’expérimentation d’achat média (A/B testing classique sur le marché réel).25

Synthèse et Impératifs Stratégiques d’Action pour les Dirigeants

La maturité complexe et interconnectée atteinte par l’écosystème numérique mondial en 2026 exige l’éradication immédiate et définitive des approches de gestion cloisonnées. La maximisation performante des lignes d’investissements digitaux, vitale pour les ETI et les grands comptes en phase d’expansion internationale, ne peut en aucun cas s’opérer dans des silos organisationnels étanches, qui persisteraient à séparer de manière artificielle les ingénieurs en charge de l’acquisition organique (AIO/SEO), les opérateurs de l’achat média payant (SEA et Social Ads automatisés) et les data scientists responsables de la qualité et de l’activation des données.3 L’ère actuelle impose sans recours possible une « Vision 360 », une doctrine d’entreprise fondée sur une synergie indissociable entre le socle de la donnée pure (GA4 paramétré pour le prédictif et l’hygiène des first-party data), l’omniprésence algorithmique automatisée et la structuration mathématique des contenus.3

Afin de sécuriser leur rentabilité à moyen terme, de défendre leurs barrières à l’entrée et de s’assurer un avantage concurrentiel définitif dans un environnement en mutation permanente, les directeurs marketing et les directions générales doivent impérativement piloter l’exécution sans faille des chantiers stratégiques suivants :

- Réingénierie Immédiate de l’Architecture Analytique (Fondations GA4) : Il est vital de mener un audit technologique exhaustif des propriétés GA4 existantes, et ce, avant toute injection de nouveaux budgets médias. Cet audit doit garantir que la taxonomie de collecte des données événementielles reflète la complexité des parcours d’affaires de l’entreprise. Il faut implémenter avec une rigueur absolue le mode de consentement local pour activer la protection juridique et amorcer les modèles de confidentialité différentielle. De manière critique, l’organisation doit s’astreindre à importer l’intégralité de ses données de coûts publicitaires dispersées, afin d’activer les moteurs d’intelligence artificielle de planification financière cross-channel (Plans de Projection et de Scénarios) et de substituer aux tableurs manuels des prévisions algorithmiques fiables.5

- L’Activation Systémique du Capital de Données Propriétaires (First-Party Data) : Il est urgent de combler le retard technologique qui affecte encore la majorité des annonceurs. Sortir des 62 % d’acteurs aveugles en connectant formellement, par le biais d’API robustes, les bases de données CRM (et autres gisements d’informations hors ligne) à l’écosystème analytique de GA4 et aux moteurs d’enchères de Google Ads.15 Ce flux de données sécurisé et constant est l’unique mécanisme qui permette d’atteindre une précision suffisante pour la création des audiences prédictives à très haute valeur, servant ainsi de « carburant algorithmique » exclusif et indétectable par la concurrence pour diriger les algorithmes de Performance Max vers la croissance du chiffre d’affaires et la modélisation du LTV, plutôt que vers la simple acquisition de trafic au CPA.4

- L’Orchestration d’une Stratégie Parallèle de Visibilité : SEO de Défense et AIO de Conquête : La dichotomie entre référencement payant et référencement naturel doit être élargie. Les entreprises doivent protéger les rentes historiques de trafic organique générique en y consacrant 70 à 80 % des ressources d’optimisation (le SEO classique). Simultanément, elles doivent engager une refonte structurelle de leur littérature web en investissant massivement les 20 à 30 % de ressources restantes dans les protocoles très techniques de l’AIO (fragmentation en segments, intégration intensive de microdonnées au format JSON-LD, génération délibérée de mentions d’autorité E-E-A-T). L’objectif absolu de cette allocation est d’imposer, de force et par la sémantique mathématique, l’identité de l’entreprise comme la source par défaut, unique et incontestable, choisie par les intelligences artificielles génératives et les futurs agents autonomes d’achats lorsqu’ils généreront des synthèses de recommandations pour leurs utilisateurs humains.7

- La Transformation de la Chaîne d’Approvisionnement Créative via l’IA Multimodale : Briser la limitation physique et financière de la production d’assets publicitaires traditionnels en intégrant profondément les capacités des intelligences artificielles génératives, à l’image des protocoles de studios de production augmentés.3 Cette démarche permet d’alimenter de manière pérenne et variée la faim insatiable des algorithmes de diffusion automatisée. Elle éradique le risque de fatigue créative des audiences et autorise l’introduction de méthodologies de validation de l’impact des messages sur des audiences virtuellement simulées avant même l’engagement financier réel.25

- Le Renoncement aux Indicateurs de Vanité et l’Exigence Transparente d’Expertise Senior : Face à l’opacité inhérente des boîtes noires des modèles d’enchères automatisés et à la volatilité intrinsèque des algorithmes des moteurs conversationnels, les directions doivent confier la gestion de leurs investissements à des entités décisionnelles justifiant d’une expertise senior approfondie. Il convient d’exiger une traduction limpide et intelligible des signaux comportementaux complexes en métriques d’affaires pures. Les reportings doivent cesser de refléter des impressions, des taux de clics ou des coûts par sessions abstraits, pour s’aligner exclusivement sur la génération de valeur commerciale incrémentale à long terme et la progression tangible des parts de marché.3

L’ère commerciale et numérique qui se déploie en 2026 récompense de manière totalement disproportionnée les structures organisationnelles qui ont fait le choix de l’agilité analytique avancée, du respect éthique des consentements et de l’intégration absolue des briques technologiques. Les directions marketing des grands comptes qui maîtriseront de concert l’architecture événementielle de GA4, la puissance aveugle de l’automatisation de l’achat média et les mécanismes vectoriels de l’AIO parviendront à transformer le vaste champ de l’incertitude macroéconomique et de la fragmentation des comportements d’achat en un ensemble de variables parfaitement pilotables, modélisables et prévisibles par l’ingénierie de l’intelligence artificielle.

Works cited

The best Consumer Marketing Agencies in Paris, accessed March 31, 2026, https://luxurymarketingagencyparis.com/consumer-marketing-agencies/paris

AI in Google Analytics 4 Guide 2026 – Talencee, accessed March 31, 2026, https://talencee.com/blog/ai-in-google-analytics-ga4-2026/

Top digital marketing trends for 2026: What professionals need to know – IE, accessed March 31, 2026, https://www.ie.edu/uncover-ie/master-in-digital-marketing-trends/

Million Marketing (+ Avis clients) – Sortlist, accessed March 31, 2026, https://www.sortlist.com/fr/agency/million-marketing

Enterprise Digital Marketing Trends 2026 | Strategy & Solutions | G & Co. – G&CO., accessed March 31, 2026, https://www.g-co.agency/insights/enterprise-digital-marketing-trends-strategy-solutions

What’s New With Google Analytics in 2026, and How to Set Up GA4 …, accessed March 31, 2026, https://medium.com/@whistlerbillboards/whats-new-with-google-analytics-in-2026-and-how-to-set-up-ga4-to-benefit-3b2b83bf496f

Million Marketing (+ reviews) – Sortlist, accessed March 31, 2026, https://www.sortlist.com/agency/million-marketing

AI in Online Advertising: 5 Key Trends from March 2026 | JumpFly Digital Marketing Blog, accessed March 31, 2026, https://www.jumpfly.com/blog/ai-in-online-advertising-5-key-trends-from-march-2026/

Best AIO Tools in 2026: AI Search Optimization Platforms Ranked – ZipTie.dev, accessed March 31, 2026, https://ziptie.dev/blog/best-aio-tools/

Everything You Need to Know About Google Analytics 4 (GA4) in 2026 – Tatvic, accessed March 31, 2026, https://www.tatvic.com/blog/everything-you-need-to-know-about-google-analytics-4-ga4-in-2025/

What are the new GA4 features in 2026? | AI Marketing Agency Australia | roi.com.au, accessed March 31, 2026, https://roi.com.au/know-how/google-analytics-ga4/what-are-the-new-ga4-features-in-2026

What’s new in Google Analytics, accessed March 31, 2026, https://support.google.com/analytics/answer/9164320?hl=en

Predict, Act, Grow: GA4 Predictive Analytics Guide for 2026 – Rebootiq, accessed March 31, 2026, https://rebootiq.com/ga4-predictive-analytics-2026/

2026 data privacy trends: Predictions from the experts – Didomi, accessed March 31, 2026, https://www.didomi.io/blog/2026-data-privacy-trends-predictions

Top digital marketing trends and predictions for 2026 – Google Business Profile, accessed March 31, 2026, https://business.google.com/aunz/think/consumer-insights/digital-marketing-trends-2026/

From retrospective to forward-facing: how GA4 is evolving in 2026 – XPON Technologies, accessed March 31, 2026, https://xpon.ai/resources/ga4-2026-features-retrospective-to-forward-facing/

GA4 & SEA 2026 | Optimisation Privacy-First EMEA – Million Marketing, accessed March 31, 2026, https://www.million-marketing.fr/ga4-sea-grands-comptes/

Agence SEA Paris pour Grands Comptes | Pilotage ROI – Million Marketing, accessed March 31, 2026, https://www.million-marketing.fr/nos-services/sea/

Artificial Intelligence Optimization (AIO): The Next Frontier in SEO | HackerNoon, accessed March 31, 2026, https://hackernoon.com/artificial-intelligence-optimization-aio-the-next-frontier-in-seo

From SEO to AIO: The Rise of Artificial Intelligence Optimization (AI Series Part 3) | im+, accessed March 31, 2026, https://www.incredible.plus/articles/aio-artificial-intelligence-optimization

4 Layers of SEO 2026 – The Complete Guide to SXO, AIO, GEO, AEO for Modern Brands – Semly.ai, accessed March 31, 2026, https://semly.ai/blog/what-will-be-the-trends-in-seo-in-2026

2026 Marketing Trends: The End of SEO? – LSEO, accessed March 31, 2026, https://lseo.com/blog/search-engine-optimization/2026-marketing-trends-the-end-of-seo/

Should You Still Do Traditional SEO in 2026 Or Focus On AIO?, accessed March 31, 2026, https://www.pageonepower.com/linkarati/ai-seo-vs-traditional-seo-which-should-you-use-in-2027

Optimize AI Search Visibility | Enterprise AIO, accessed March 31, 2026, https://enterprise.semrush.com/solutions/ai-optimization/

The Marketing Strategy for $1 Million in 2026 – YouTube, accessed March 31, 2026, https://www.youtube.com/watch?v=pzmItMP1UwE

2026 Digital Advertising Trends Report – Smartly, accessed March 31, 2026, https://www.smartly.io/digital-advertising-trends/2026